Maak kennis met Mixtral 8x7B van Mistral AI. Het is super slim in het omgaan met big data en kan helpen met taken zoals het vertalen van talen en het genereren van code. Ontwikkelaars over de hele wereld zijn enthousiast over het potentieel om hun projecten te stroomlijnen en de efficiëntie te verbeteren. Met zijn gebruiksvriendelijke ontwerp en indrukwekkende mogelijkheden wordt Mixtral 8x7B snel een go-to-tool voor AI-ontwikkeling.

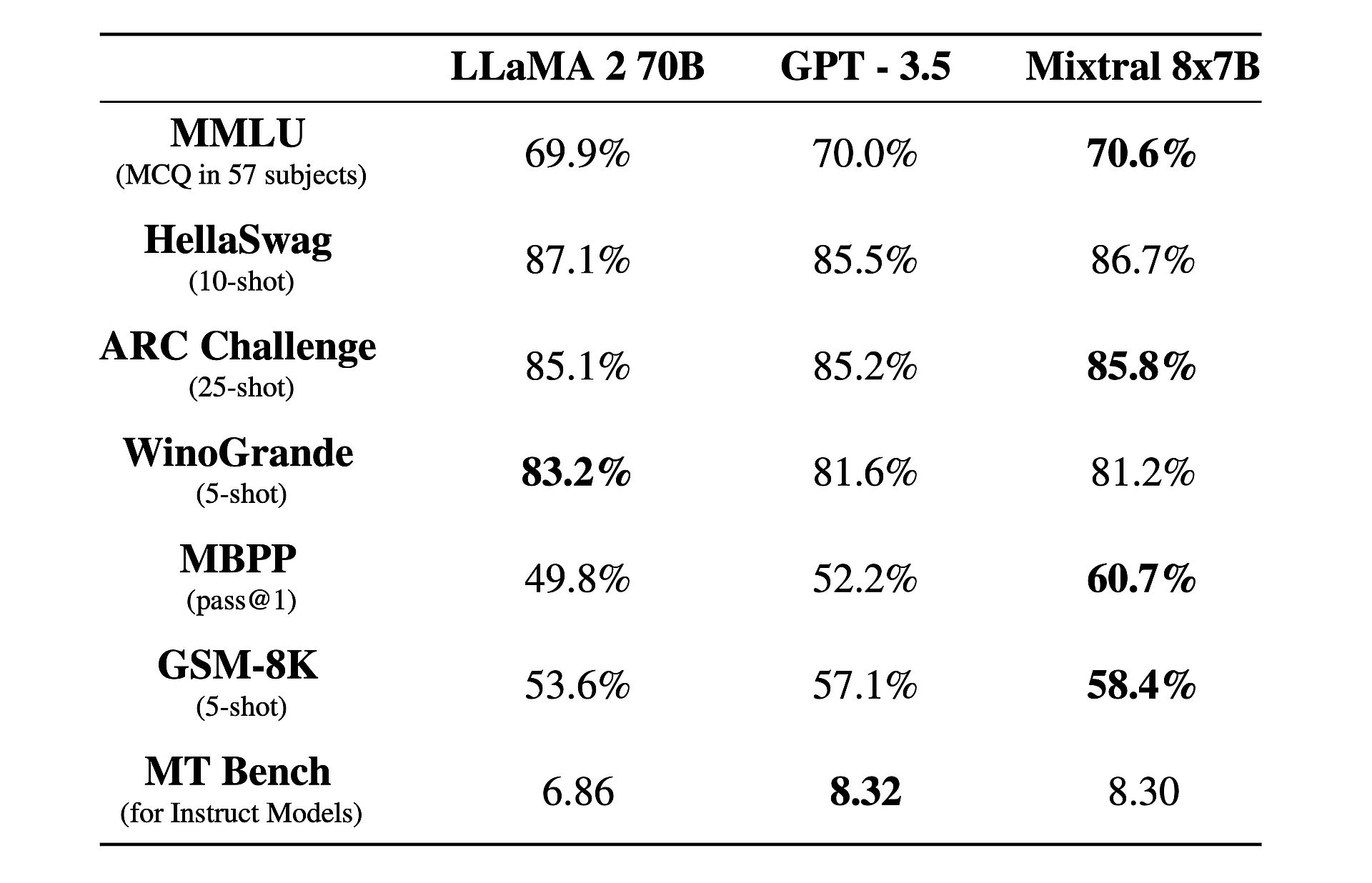

Er is ook een interessant feit: het presteert beter dan GPT-3.5 En Lama 2!

Wat is Mixtral 8x7B?

Mixtral 8x7B is een geavanceerd kunstmatige-intelligentiemodel ontwikkeld door Mistral AI. Het maakt gebruik van een unieke architectuur, sparse mix-of-experts (SMoE) genoemd, om grote hoeveelheden gegevens efficiënt te verwerken. Ondanks de complexiteit is Mixtral ontworpen om gemakkelijk te gebruiken en aanpasbaar te zijn voor verschillende taken, zoals taalvertaling en het genereren van code. Het presteert beter dan andere modellen op het gebied van snelheid en nauwkeurigheid, waardoor het een waardevol hulpmiddel is voor ontwikkelaars. Bovendien is het beschikbaar onder de Apache 2.0-licentie, zodat iedereen het vrijelijk kan gebruiken en wijzigen.

Wilt u meer weten? In wezen werkt Mixtral 8x7B als een model met alleen een decoder, waarbij gebruik wordt gemaakt van een unieke aanpak waarbij een feedforward-blok selecteert uit acht verschillende groepen parameters, ook wel ‘experts’ genoemd. Deze experts worden dynamisch gekozen door een routernetwerk om elk token te verwerken, waardoor de efficiëntie en prestaties worden verbeterd en de rekenkundige overhead wordt geminimaliseerd.

Een van de belangrijkste sterke punten van Mixtral ligt in het aanpassingsvermogen en de schaalbaarheid ervan. Capable kan contexten tot 32.000 tokens verwerken en meerdere talen ondersteunen, waaronder Engels, Frans, Italiaans, Duits en Spaans. Mixtral stelt ontwikkelaars in staat een breed scala aan taken met gemak en precisie uit te voeren.

Wat Mixtral echt onderscheidt, is de prestatie-kostenverhouding. Met een duizelingwekkend totaal van 46,7 miljard parameters bereikt Mixtral opmerkelijke efficiëntie door slechts een fractie van deze parameters per token te gebruiken, wat resulteert in snellere inferentietijden en lagere rekenkosten.

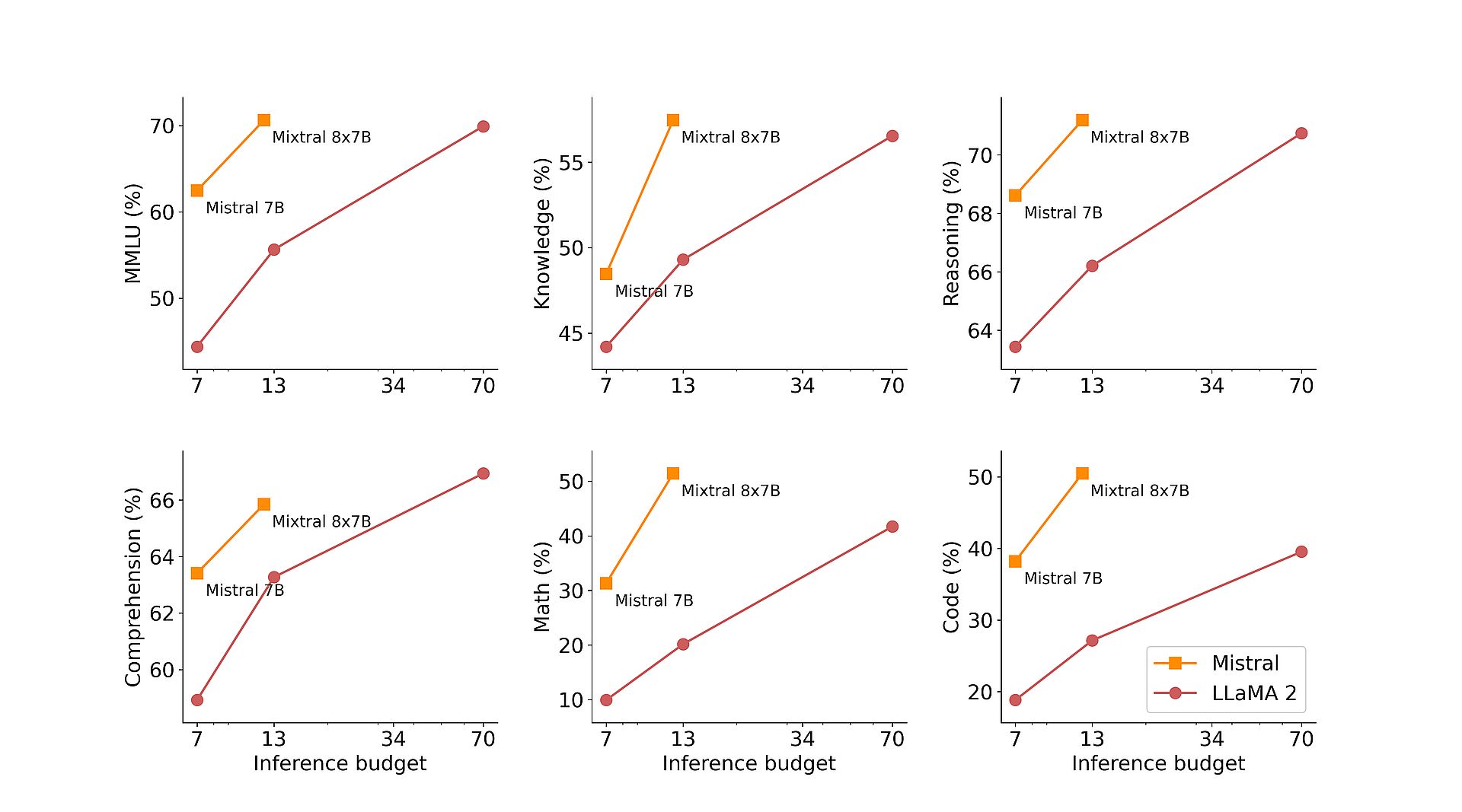

Bovendien zorgt de voortraining van Mixtral over uitgebreide datasets afkomstig van het open web voor robuustheid en veelzijdigheid in toepassingen in de echte wereld. Of het nu gaat om het genereren van code, taalvertaling of sentimentanalyse, Mixtral levert uitstekende resultaten in verschillende benchmarks, overtreft traditionele modellen zoals Llama 2 en presteert in veel gevallen zelfs beter dan GPT3.5.

Om zijn mogelijkheden verder te verbeteren, heeft Mistral AI Mixtral 8x7B Instruct geïntroduceerd, een gespecialiseerde variant die is geoptimaliseerd voor instructievolgende taken. Met een indrukwekkende score van 8,30 op de MT-Bench verstevigt Mixtral 8x7B Instruct zijn positie als toonaangevend open-sourcemodel voor gecontroleerde afstemming en voorkeursoptimalisatie.

Naast zijn technische bekwaamheid zet Mistral AI zich in voor het democratiseren van de toegang tot Mixtral door bij te dragen aan het vLLM-project, waardoor naadloze integratie en implementatie met open-sourcetools mogelijk wordt. Dit stelt ontwikkelaars in staat de kracht van Mixtral te benutten voor een breed scala aan applicaties en platforms, waardoor innovatie en vooruitgang op het gebied van kunstmatige intelligentie wordt gestimuleerd.

Groq AIniet Grok, roostert Elon Musk met zijn “snelste LLM”

Hoe gebruikt u Mixtral 8x7B?

Mixtral 8x7B is toegankelijk via Mistral’s eindpunt mistral-small, dat zich in de bètatestfasene. Als u geïnteresseerd bent in het verkrijgen van vroege toegang tot alle generatieve en insluitende eindpunten van Mistral, kunt u register nu. Door u te registreren, zult u een van de eersten zijn die de volledige mogelijkheden van Mixtral 8x7B ervaart en de innovatieve oplossingen ervan ontdekt.