Google heeft een innovatief AI-framework geïntroduceerd met de naam ‘Sociaal Leren’, ontworpen om de samenwerkingsvaardigheid van taalmodellen te vergroten en tegelijkertijd de privacy van gebruikers te beschermen. Dit nieuwe raamwerk maakt het voor AI-modellen mogelijk om natuurlijke taaluitwisselingen aan te gaan, inzichten te delen en hun collectieve vaardigheden bij diverse taken te vergroten zonder de privacy te schenden.

- Het concept inspireert uit de theorie van sociaal leren van Bandura en Walters uit 1977waarbij de nadruk wordt gelegd op leren door observatie, hetzij door verbale instructie, hetzij door waargenomen gedrag na te bootsen.

- In tegenstelling tot traditionele methoden voor collaboratief leren, waarbij directe gegevensuitwisseling mogelijk is, is deze aanpak een goede manier om te leren stelt LLM’s in staat om van elkaar te onderwijzen en van elkaar te leren met behulp van natuurlijke taalwaardoor privacyproblemen worden omzeild.

- Het artikel bespreekt de toepassing van het raamwerk op verschillende taken, waaronder spamdetectie, het oplossen van wiskundeproblemen op de basisschool en het beantwoorden van vragen op tekstbasiswat de veelzijdigheid ervan laat zien.

“Grote taalmodellen (LLM’s) hebben de stand van de techniek voor het oplossen van taken die zijn gespecificeerd met behulp van natuurlijke taal aanzienlijk verbeterd, waarbij vaak prestaties worden bereikt die dicht bij die van mensen liggen. Omdat deze modellen steeds meer hulpagenten in staat stellen, zou het nuttig voor hen kunnen zijn om effectief van elkaar te leren, net zoals mensen dat doen in sociale omgevingen, waardoor LLM-gebaseerde agenten elkaars prestaties zouden kunnen verbeteren.

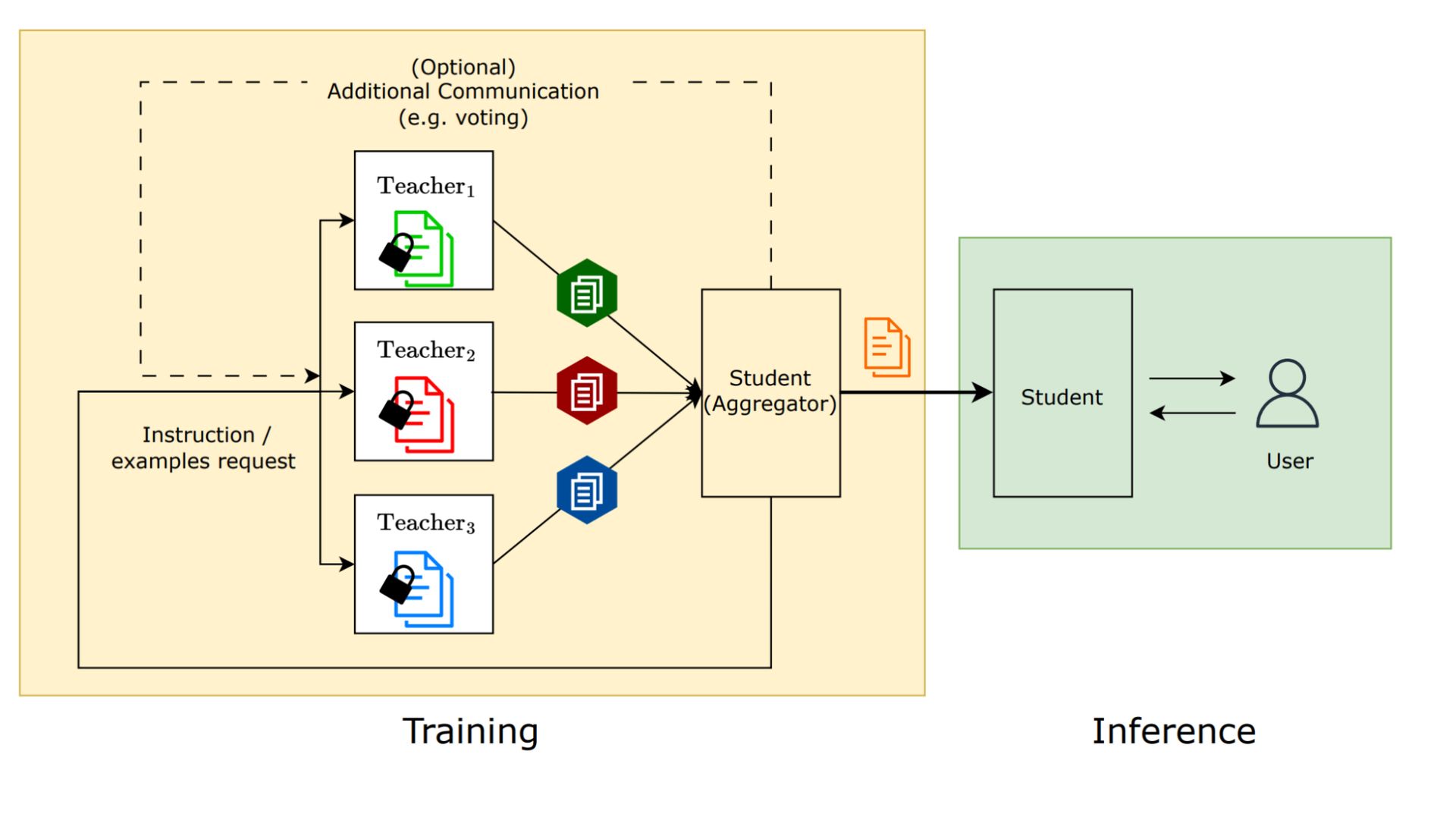

Hoe werkt Sociaal Leren van Google?

Binnen de Social Learning-opzet “docent” modellen brengen kennis over naar “student”-modellen zonder de noodzaak om gevoelige of privé-informatie door te geven, waardoor een evenwicht wordt gevonden tussen effectief leren en privacybehoud. Deze leerlingmodellen trekken lessen uit verschillende lerarenmodellen, die elk gespecialiseerd zijn in specifieke taken zoals het detecteren van spam, het oplossen van wiskundige puzzels of het geven van antwoorden op basis van tekstuele inhoud.

Door voorbeelden te gebruiken die door mensen zijn doorgelicht, kunnen lerarenmodellen leerlingmodellen onderwijzen zonder de originele gegevens uit te wisselen. Daarmee wordt tegemoetgekomen aan de privacyproblemen die verband houden met het delen van gegevens. Bovendien hebben lerarenmodellen de mogelijkheid om nieuwe scenario’s te maken of specifieke taakinstructies te creëren, waardoor het educatieve traject wordt verrijkt.

Onderzoeksproeven onderstrepen het succes van sociaal leren bij het vergroten van de competenties van leerlingmodellen voor een reeks taken. De synthetische scenario’s die door lerarenmodellen zijn bedacht, zijn net zo impactvol gebleken als de authentieke gegevens, terwijl de gevaren voor de privacy drastisch worden verminderd. Op dezelfde manier hebben taakinstructies, opgesteld door lerarenmodellen, een belangrijke rol gespeeld bij het verbeteren van de prestaties van leerlingmodellen, wat de veelzijdigheid van de taalmodellen bij het naleven van richtlijnen aantoont.

Om de privacybescherming te verankeren, de onderzoeksgemeenschap heeft maatregelen genomen zoals de Secret Sharer-metriek om de omvang van de blootstelling aan gegevens tijdens de leerfase te evalueren. De bevindingen laten een verwaarloosbare hoeveelheid privacygegevens zien, wat het vermogen van het raamwerk om instructies te geven bevestigt zonder details uit de oorspronkelijke datapool vrij te geven.

Hoe AI het onderwijs verbetert met gepersonaliseerd leren op schaal en andere nieuwe mogelijkheden

Door het menselijke proces van sociaal leren na te bootsen, zijn deze modellen dat wel bedreven in het uitwisselen van kennis en het collectief verbeteren van hun capaciteiten, terwijl de privacy van gebruikers voorop staat. Deze strategie opent nieuwe wegen voor het creëren van privacybewuste AI-technologieën op uiteenlopende terreinen. Vooruitkijkend zijn de onderzoeksteams van plan het raamwerk voor sociaal leren verder te verfijnen en zich te verdiepen in de bruikbaarheid ervan in diverse taken en datacontexten.

“We hebben een raamwerk voor sociaal leren geïntroduceerd waarmee taalmodellen met toegang tot privégegevens kennis kunnen overdragen via tekstuele communicatie, terwijl de privacy van die gegevens behouden blijft. In dit raamwerk hebben we het delen van voorbeelden en het delen van instructies als basismodellen geïdentificeerd en deze op meerdere taken geëvalueerd. Bovendien hebben we de Secret Sharer-metriek aan ons raamwerk aangepast en een metriek voorgesteld voor het meten van datalekken”, aldus Google in zijn rapport. blogpost.

“Als volgende stappen zoeken we naar manieren om het onderwijsproces te verbeteren, bijvoorbeeld door feedbackloops en iteratie toe te voegen. Bovendien willen we het gebruik van sociaal leren voor andere modaliteiten dan tekst onderzoeken”, aldus de blogpost.

Uitgelichte afbeeldingscredits: Mitchell Luo/Unsplash