De grens tussen wat echt is en wat gefabriceerd is, wordt tegenwoordig erg vaag en YouTube heeft een oplossing.

YouTube, de plek waar je vrijwel alles kunt bekijken, komt met nieuwe regels om ervoor te zorgen dat we het verschil kunnen zien.

Ze weten, net als wij allemaal, dat de manier waarop kunstmatige intelligentie video’s kan maken zowel verbazingwekkend als een beetje eng is.

Het transparantie-initiatief van YouTube

Het probleem is dat AI kan worden gebruikt om video’s te maken die de grens tussen echt en nep vervagen. Deepfakes, waarbij iemands gelijkenis en stem worden gemanipuleerd, kunnen schadelijke instrumenten voor nabootsing van identiteit zijn. Synthetische stemmen kunnen video’s met misleidende informatie vertellen, en zelfs ogenschijnlijk echte video’s kunnen subtiele, door AI ondersteunde bewerkingen bevatten. De kans op misbruik is zeer reëel.

Denk er eens over na: AI kan iemands gezicht en stem in een video verwisselen, waardoor hij of zij dingen zegt en doet die hij nooit heeft gedaan. Dat is het hele deepfake-gedoe, en het wordt snel verontrustend. Dan zijn er die door de computer gemaakte stemmen die zo echt klinken dat je zou kunnen zweren dat je naar een echt persoon luistert… totdat je beseft dat het gewoon een programma is dat leugens verspreidt. Zelfs ‘gewone’ video’s kunnen stiekeme AI-bewerkingen bevatten die het hele verhaal veranderen.

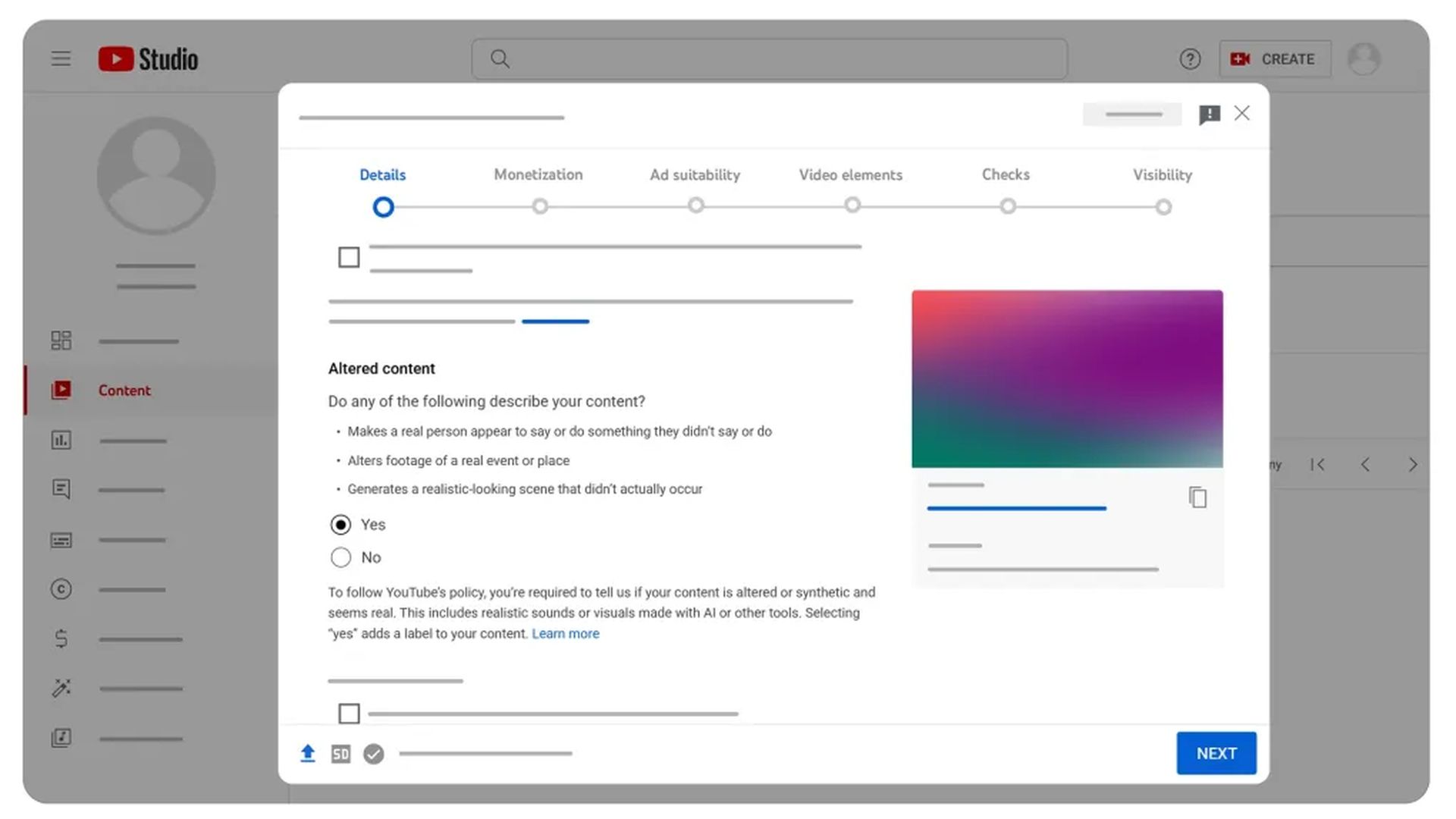

Om dit te bestrijdenYouTube vraagt makers om bekend te maken wanneer hun video’s door AI gegenereerde elementen bevatten die niet meteen duidelijk zijn. Dit kan het toevoegen van informatie aan de videobeschrijving omvatten

Aanvullend, video’s over gevoelige onderwerpen zoals politiek of gezondheid kunnen rechtstreeks op de videospeler zelf een label krijgen voor extra context.

YouTube ook waarschijnlijk systemen ontwikkelen om video’s automatisch te detecteren die mogelijk niet-openbaar gemaakte AI-elementen bevatten. Dit is van cruciaal belang omdat een menselijke beoordeling van elke afzonderlijke upload simpelweg niet haalbaar is. Deze AI-detectietools scannen op patronen en afwijkingen die duiden op digitale manipulatie. Dit kan variëren van het analyseren van de consistentie van de stempatronen van een spreker tot het detecteren van subtiele visuele storingen veroorzaakt door deepfake-technologie.

Het brengt echter ook een uitdaging met zich mee: naarmate de technieken voor het genereren van AI zich ontwikkelen, moeten de detectiesystemen ook voortdurend evolueren, waardoor een soort technologische wapenwedloop ontstaat.

Manipulatie versus creatieve expressie

Er is een verschil tussen misleidende video’s die bedoeld zijn om schade toe te brengen en makers van inhoud die AI gebruiken voor artistieke doeleinden. Denk aan die fantastische muziekvideo’s waarin alles verandert en transformeert – uiteraard niet echt, maar geweldig om naar te kijken. Of filmmakers die AI gebruiken om werelden te creëren die we ons anders niet zouden kunnen voorstellen.

Waar trekken we de lijn tussen schadelijk bedrog en opwindende nieuwe vormen van entertainment en verhalen vertellen?

Eerlijkheid duurt het langst

Oké, natuurlijk, soms is het gewoon leuk om die dwaze deepfakes van politici te zien die popliedjes zingen. Maar als het om serieuze zaken gaat, weten wat echt is, doet er heel veel toe.

Desinformatie verspreidt zich als een lopend vuurtje (onthoud die TikTok-video’s over dieseltruck in brand?), en als mensen iets geloven alleen maar omdat het in een video staat, is dat een probleem. En denk eens aan de persoon wiens gezicht op een video is geplakt waar hij nooit in wilde verschijnen: dat klopt gewoon niet. Dat is waar transparantie ons als kijkers beschermt, en de mensen die uiteindelijk het doelwit kunnen worden van een misleidende AI-video.

Het innemen van een standpunt door YouTube is een goed begin, maar we mogen niet zelfgenoegzaam worden. De technologie verandert snel, en degenen die ons proberen te misleiden zullen ook slimmer worden. Het is aan ons, kijkers, om ons denkvermogen op peil te houden.

Vraag je af wat je zietneem niet zomaar een video op het eerste gezicht, en wees altijd bereid om dieper te graven om erachter te komen of iets echt is.

Uitgelicht beeldtegoed: Freepik.