Colossus is een baanbrekend trainingssysteem voor kunstmatige intelligentie (AI) dat is ontwikkeld door Elon Musk xAI CorpDeze supercomputer, door Musk omschreven als de “het krachtigste AI-trainingssysteem ter wereld,” is een cruciaal onderdeel van de strategie van xAI om een leidende rol te spelen in het snel evoluerende veld van AI.

Dit weekend is de @xAI team bracht ons Colossus 100k H100-trainingscluster online. Van begin tot eind was het in 122 dagen gedaan.

Colossus is het krachtigste AI-trainingssysteem ter wereld. Bovendien zal het in een paar maanden verdubbelen in omvang tot 200k (50k H200s).

Uitstekend…

— Elon Musk (@elonmusk) 2 september 2024

Nvidia zal de Colossus aandrijven

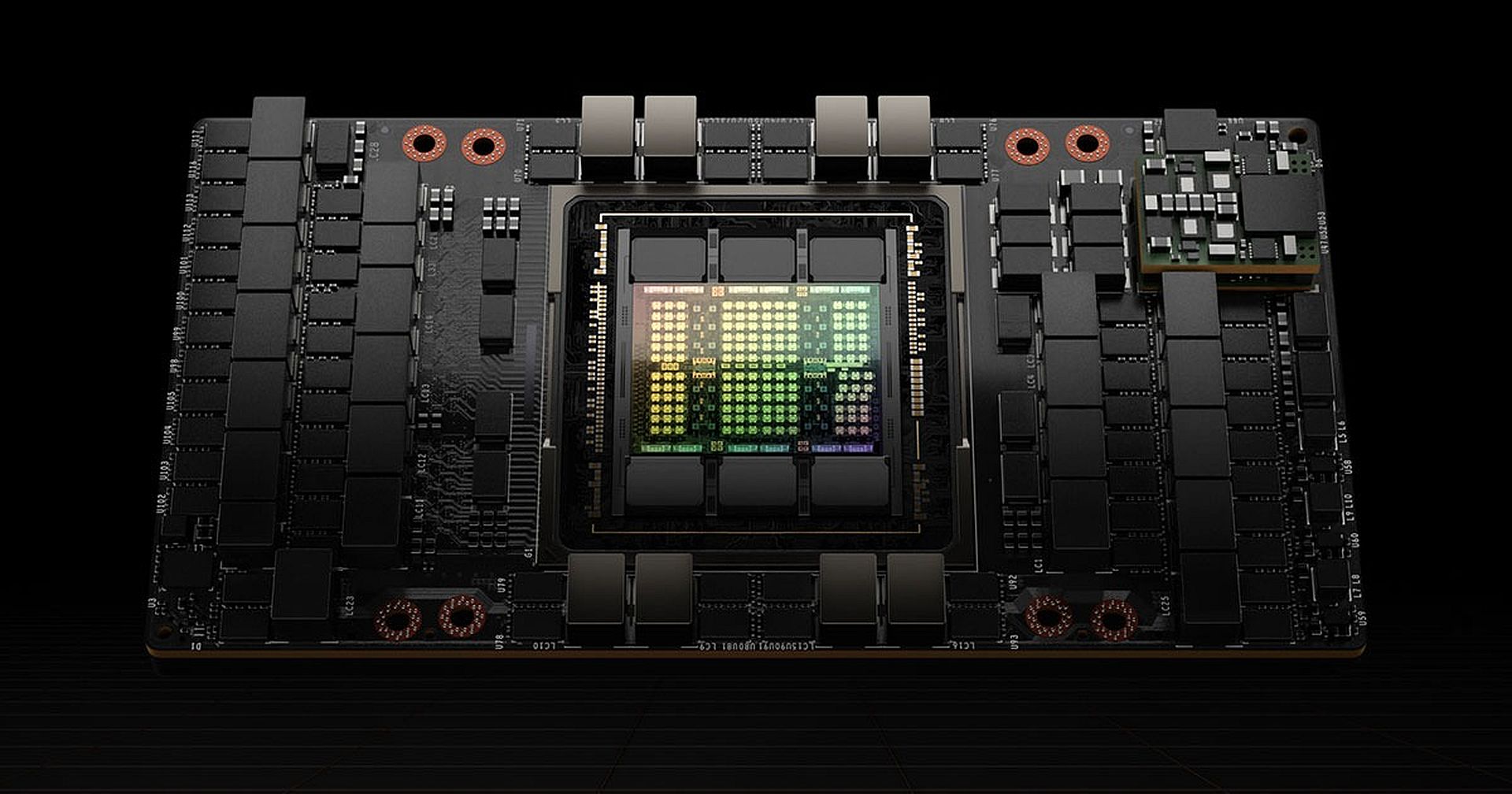

De kern van Colossus bestaat uit: 100.000 NVIDIA H100 grafische kaarten. Deze GPU’s (Graphics Processing Units) zijn speciaal ontworpen om de veeleisende rekenvereisten van AI-training aan te kunnen. Daarom zijn deze GPU’s zo belangrijk:

- Ruwe verwerkingskracht: De H100 is Nvidia’s vlaggenschip AI-processor, ontworpen om de training en inferentie van AI-modellen te versnellen, met name die gebaseerd op deep learning en neurale netwerken. Vergeleken met zijn voorganger kan de H100 taalmodellen uitvoeren tot 30 keer sneller.

- Transformator motor: Een belangrijk kenmerk van de H100 is de Transformer Engine, een gespecialiseerde set circuits die is geoptimaliseerd voor het uitvoeren van AI-modellen op basis van de Transformer neurale netwerkarchitectuur. Deze architectuur is de ruggengraat van enkele van de meest geavanceerde taalmodellen, zoals GPT-4 En Meta’s Lama 3.1 405BDankzij de Transformer Engine kunnen deze GPU’s grootschalige modellen efficiënter verwerken, waardoor ze ideaal zijn voor het trainen van geavanceerde AI-systemen.

Het volgende niveau: verdubbelen met de H200

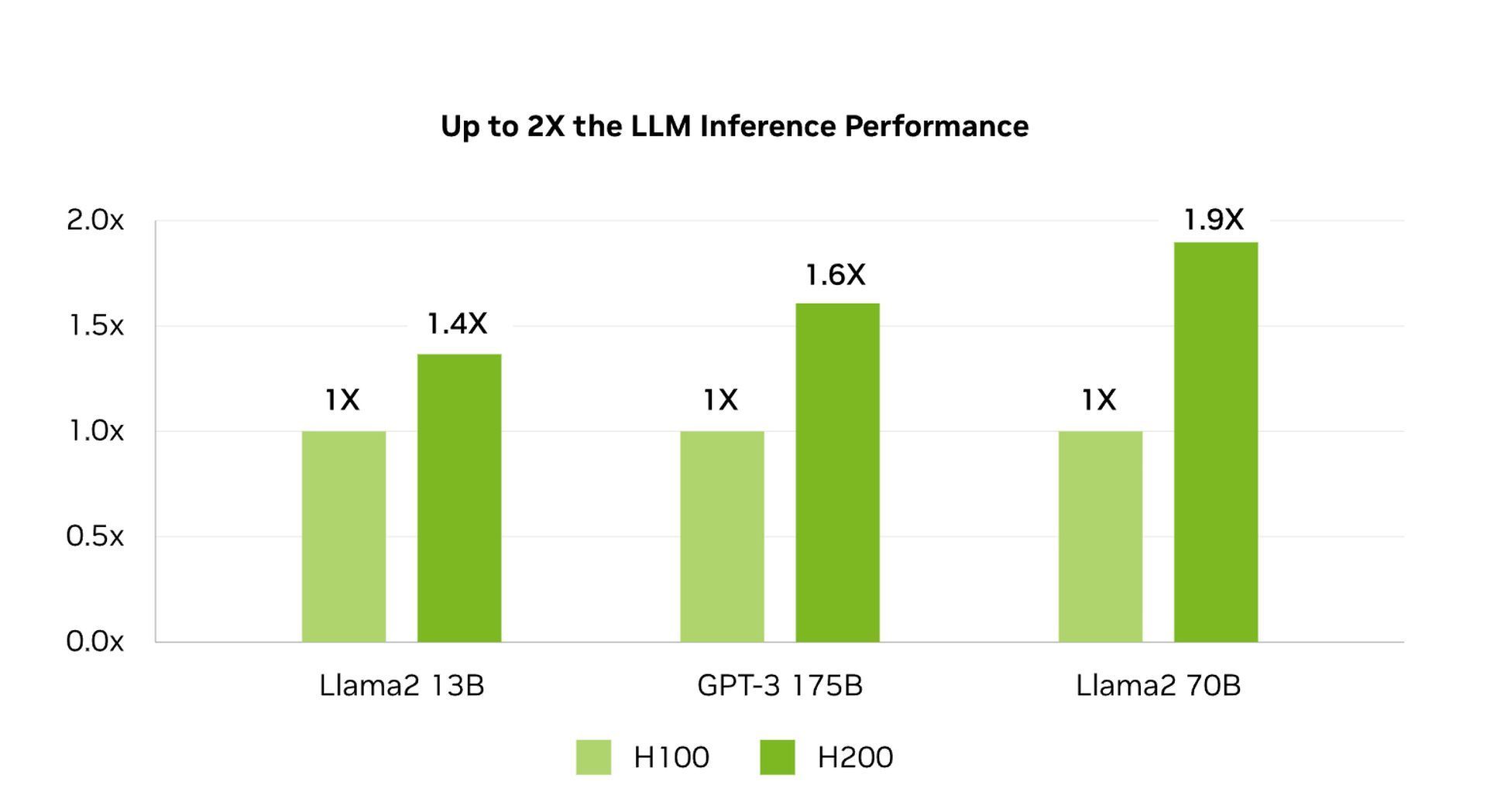

Musk heeft ambitieuze plannen om Colossus verder uit te breiden, met als doel het aantal GPU’s van het systeem te verdubbelen om 200.000 in de nabije toekomst. Deze uitbreiding zal 50.000 eenheden van De H200 van Nvidiaeen nog krachtigere opvolger van de H100. De H200 biedt verschillende belangrijke upgrades:

- HBM3e-geheugen: De H200 gebruikt High Bandwidth Memory 3e (HBM3e), wat sneller is dan de HBM3 die in de H100 wordt gebruikt. Dit type geheugen verbetert de snelheid waarmee gegevens worden overgedragen tussen het geheugen en de logische circuits van de chip. Voor AI-modellen, die voortdurend grote hoeveelheden gegevens tussen verwerking en geheugen verplaatsen, is deze snelheid cruciaal.

- Verhoogde geheugencapaciteit: De H200 verdubbelt bijna de ingebouwde geheugencapaciteit tot 141 gigabyte. Hierdoor kan de GPU meer van de data van een AI-model dichter bij zijn logische circuits opslaan, waardoor de noodzaak om data op te halen uit tragere opslagbronnen afneemt. Het resultaat is snellere verwerkingstijden en efficiëntere modeltraining.

De rol van Colossus in AI-training

Colossus is speciaal ontworpen om te trainen grote taalmodellen (LLM’s)die de basis vormen voor geavanceerde AI-toepassingen.

Het grote aantal GPU’s in Colossus stelt xAI in staat om AI-modellen te trainen op een schaal en snelheid die ongeëvenaard is door andere systemen. Bijvoorbeeld, xAI’s huidige vlaggenschip LLM, Grok-2, werd getraind op 15.000 GPU’s. Met 100.000 GPU’s die nu beschikbaar zijn, kan xAI veel grotere en complexere modellen trainen, wat mogelijk leidt tot aanzienlijke verbeteringen in AI-mogelijkheden.

De geavanceerde architectuur van de H100 en H200 GPU’s zorgt ervoor dat modellen niet alleen sneller maar ook met grotere precisie worden getraind. De hoge geheugencapaciteit en snelle gegevensoverdrachtsmogelijkheden betekenen dat zelfs de meest complexe AI-modellen efficiënter kunnen worden getraind, wat resulteert in betere prestaties en nauwkeurigheid.

Wat nu?

Colossus is niet alleen een technische prestatie; het is een strategische troef in xAI’s missie om de AI-industrie te domineren. Door ’s werelds krachtigste AI-trainingssysteem te bouwen, positioneert xAI zichzelf als een leider in het ontwikkelen van geavanceerde AI-modellen. Dit systeem geeft xAI een concurrentievoordeel ten opzichte van andere AI-bedrijven, waaronder OpenAI, waar Musk momenteel in zit juridisch conflict met.

Bovendien weerspiegelt de bouw van Colossus Musks bredere visie op AI. Door middelen van Tesla naar xAI te verplaatsen, inclusief de omleiding van 12.000 H100 GPU’s ter waarde van meer dan $ 500 miljoen, toont Musk zijn toewijding aan AI als een centrale focus van zijn zakenimperium.

Kan het hem lukken? We moeten wachten op het antwoord!

Bron van de hoofdafbeelding: Eray Eliasik/Grok