Tsinghua-universiteit En Zhipu-AI hebben in samenwerking CogVideoX geïntroduceerd, een open-source tekst-naar-videomodel dat klaar is om AI-zwaargewichten als Landingsbaan, Luma-AIEn Pika-laboratoriaDeze innovatie, die in een recente publicatie van arXiv wordt beschreven, biedt ontwikkelaars over de hele wereld geavanceerde mogelijkheden voor videogeneratie.

CogVideoX: Nieuwe open-source tekst-naar-video AI-tool

“We introduceren CogVideoX, grootschalige diffusietransformatormodellen die zijn ontworpen voor het genereren van video’s op basis van tekstprompts. Om videodata efficiënt te modelleren, stellen we voor om een 3D Variational Autoencoder (VAE) te gebruiken om video’s te comprimeren langs zowel ruimtelijke als temporele dimensies. Om de tekst-video-uitlijning te verbeteren, stellen we een experttransformator voor met de expert adaptieve LayerNorm om de diepe fusie tussen de twee modaliteiten te vergemakkelijken. Door een progressieve trainingstechniek te gebruiken, is CogVideoX bedreven in het produceren van coherente, langdurige video’s die worden gekenmerkt door significante bewegingen,” de papier leest.

Onlangs werkten ze samen aan OpenVoice, een open-source platform voor het klonen van stemmen dat samen met MIT is ontwikkeld en MijnShellen nu hebben ze CogVideoX-5B geïntroduceerd, een tekst-naar-videomodel. Ze zijn ook een partnerschap aangegaan met Shengshu Technology om Vidu-AIeen tool die is ontworpen om het maken van video’s met behulp van AI te vereenvoudigen.

CogVideoX kan op basis van eenvoudige tekstberichten hoogwaardige, samenhangende video’s van maximaal zes seconden maken.

Het opvallende model, CogVideoX-5B, heeft 5 miljard parameters en produceert video’s met een resolutie van 720×480 en 8 frames per seconde. Hoewel deze specificaties misschien niet kunnen wedijveren met de nieuwste propriëtaire systemen, ligt de echte doorbraak in de open-sourcebenadering van CogVideoX.

Open-sourcemodellen revolutioneren het veld door rhun code- en modelgewichten vrijgeven voor het publiek heeft het Tsinghua-team effectief een technologie gedemocratiseerd die ooit het domein was van goed gefinancierde techgiganten. Deze stap zal naar verwachting de vooruitgang in AI-gegenereerde video versnellen door gebruik te maken van de collectieve expertise van de wereldwijde ontwikkelaarscommunity.

De onderzoekers bereikten de indrukwekkende resultaten van CogVideoX door middel van verschillende belangrijke innovaties, waaronder een 3D Variationele Autoencoder voor efficiënte videocompressie en een “experttransformator” die is ontworpen om de uitlijning van tekst en video te verbeteren.

“Om de uitlijning tussen video’s en teksten te verbeteren, stellen we een expert Transformer voor met expert adaptieve LayerNorm om de fusie tussen de twee modaliteiten te vergemakkelijken”, legt het artikel uit. Deze doorbraak maakt een nauwkeurigere interpretatie van tekstprompts en een nauwkeurigere videogeneratie mogelijk.

Hoe probeer ik CogVideoX?

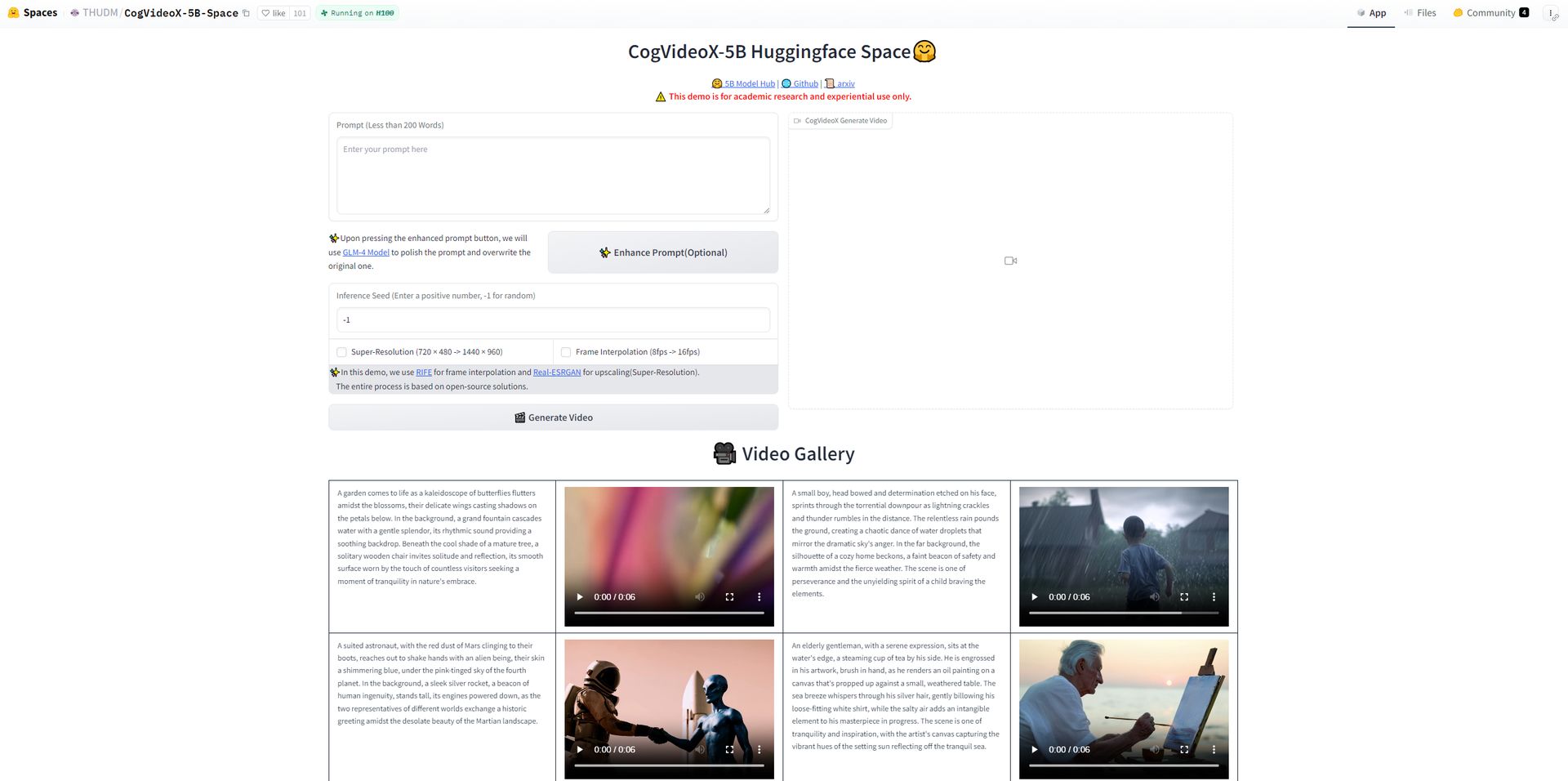

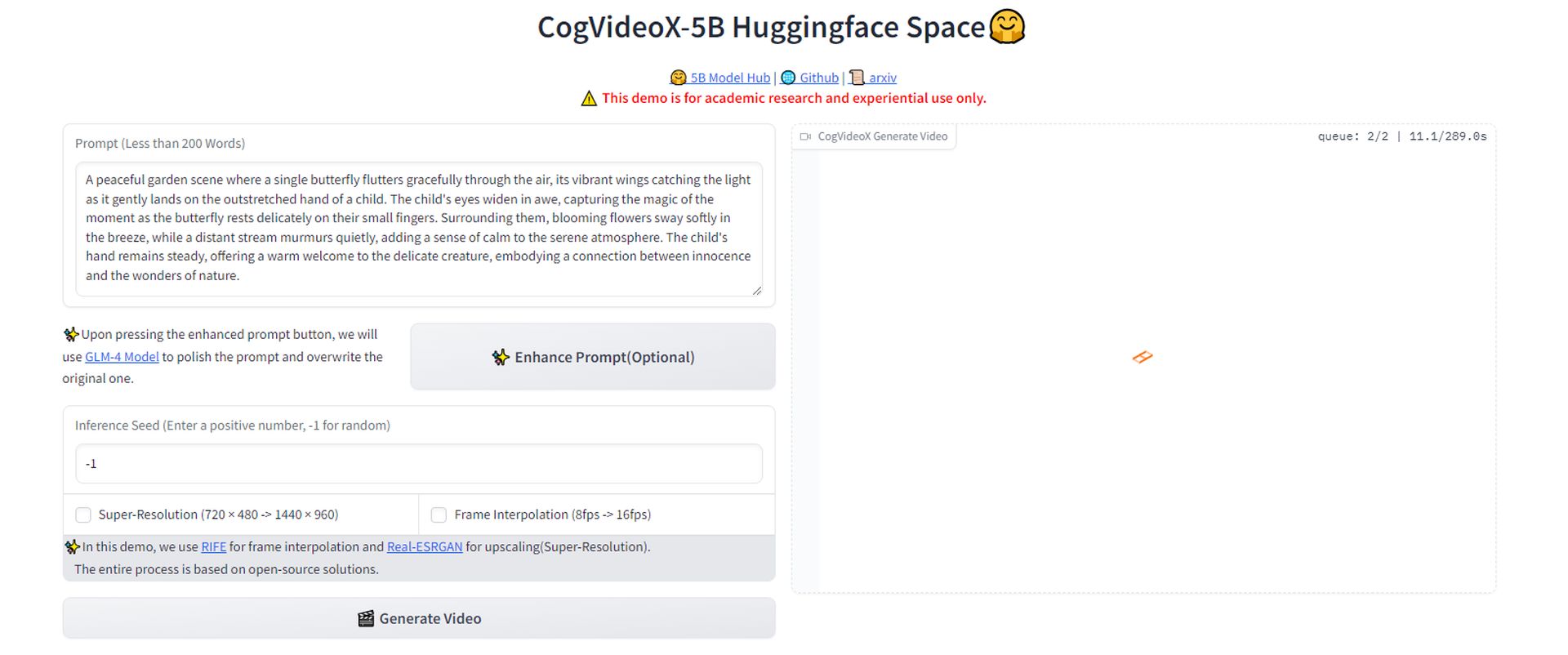

- Begin door naar het HuggingFace-platform te gaan waar de CogVideoX-5B open-source videogeneratietool is beschikbaar voor testen.

- Maak een beschrijvende opdracht voor de video die u wilt genereren. Wij gebruikten bijvoorbeeld:

- Zodra uw prompt klaar is, Klik op de knop om de video te genereren. U moet even wachten terwijl de tool uw verzoek verwerkt en de video maakt op basis van uw beschrijving.

- Nadat de video is gegenereerd, kunt u deze rechtstreeks van het platform downloaden. Hiermee kunt u het resultaat van uw opdracht bekijken en zien hoe nauwkeurig de tool uw beschrijving heeft geïnterpreteerd.

- Bekijk de video. Hoewel het resultaat misschien niet overweldigend is, is het belangrijk om op te merken dat dit soort tools snel verbeteren. Net zoals we zagen met de evolutie van ChatGPT, is een significante doorbraak in AI-gegenereerde video waarschijnlijk in aantocht.

Heb het uitgeprobeerd – hoewel het nog niet overweldigend is, duiken deze tools overal op. Verwacht binnenkort een doorbraak, net zoals we zagen met ChatGPT. foto.twitter.com/53xYz6lBLf

— Kerem Gülen (@kgulenn) 28 augustus 2024

We gaan steeds meer deepfakes zien

Toch brengt de brede beschikbaarheid van zulke krachtige technologie ook gevaren met zich mee. Het potentieel voor misbruik, met name bij het maken van deepfakes of misleidende content, is een serieus probleem waar de AI-community mee te maken krijgt. De onderzoekers zelf erkennen deze ethische zorgen en dringen erop aan dat de technologie verantwoord wordt gebruikt.

Nu AI-gegenereerde video steeds toegankelijker en geavanceerder wordt, begeven we ons op onbekend terrein in de creatie van digitale content. De lancering van CogVideoX zou een heel belangrijk moment kunnen zijn, waarbij de macht van de grote spelers in het veld mogelijk wordt herverdeeld naar een opener, gedecentraliseerd model van AI-ontwikkeling.

De werkelijke effecten van deze democratisering zijn nog onzeker. Zal het een nieuwe golf van creativiteit en innovatie creëren, of zal het de bestaande problemen van misinformatie en digitale manipulatie verergeren?

Bron van de hoofdafbeelding: Kerem Gülen/Midjourney