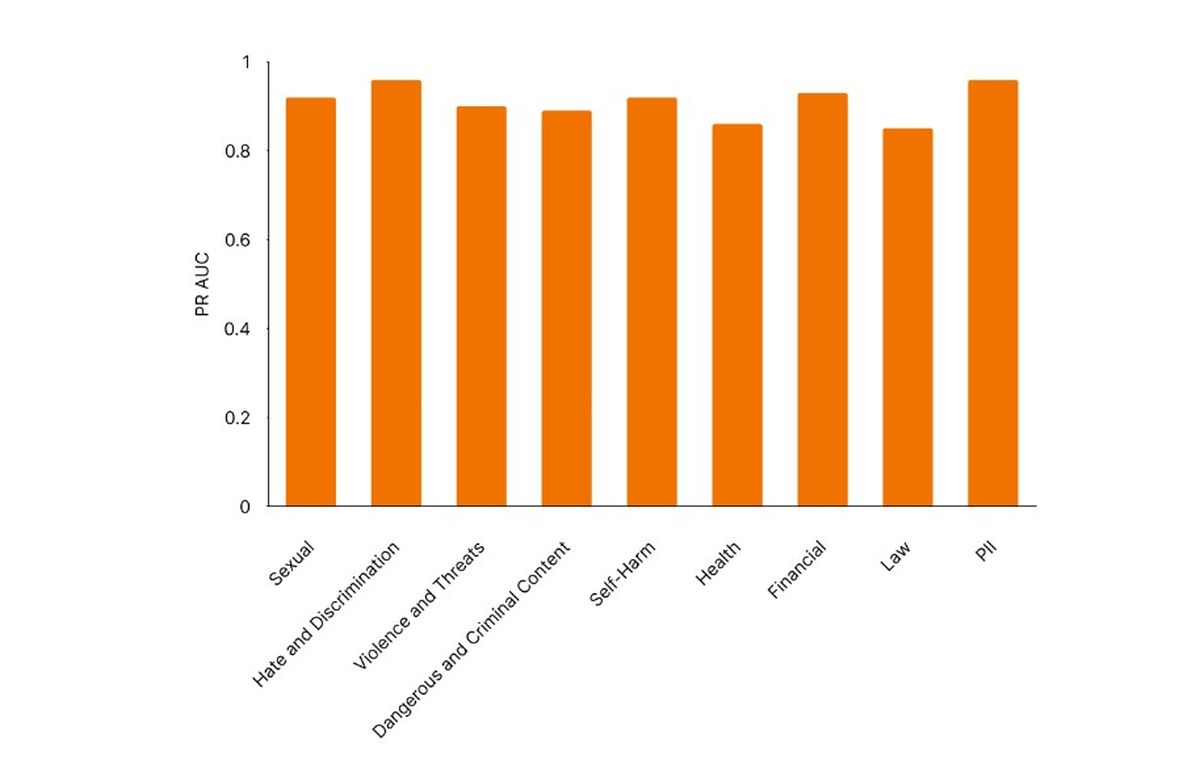

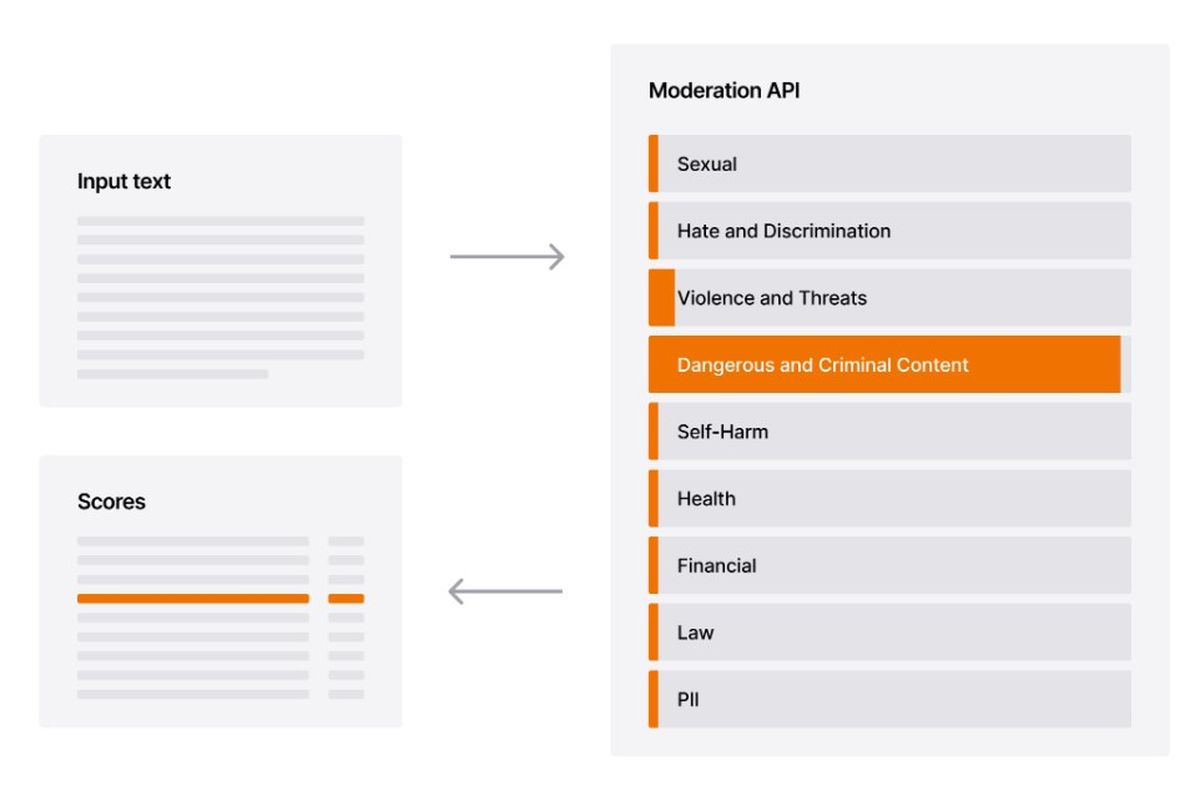

Mistral AI heeft aangekondigd de release van de nieuwe contentmoderatie-API. Deze API, die al de Le Chat-chatbot van Mistral aanstuurt, is ontworpen om ongewenste tekst te classificeren en te beheren binnen een verscheidenheid aan veiligheidsnormen en specifieke toepassingen. De moderatietool van Mistral maakt gebruik van een verfijnd taalmodel genaamd Ministral 8B, dat meerdere talen kan verwerken, waaronder Engels, Frans en Duits, en inhoud in negen verschillende typen kan categoriseren: seksuele inhoud, haat en discriminatie, geweld en bedreigingen, gevaarlijk of crimineel activiteiten, zelfbeschadiging, gezondheid, financiële, juridische en persoonlijk identificeerbare informatie (PII).

De moderatie-API is veelzijdig, met toepassingen voor zowel onbewerkte tekst als conversatieberichten. “De afgelopen maanden hebben we binnen de industrie en de onderzoeksgemeenschap een groeiend enthousiasme gezien voor nieuwe, op AI gebaseerde moderatiesystemen, die kunnen helpen moderatie schaalbaarder en robuuster te maken voor alle applicaties”, deelde Mistral in een recente blogpost. Het bedrijf beschrijft zijn aanpak als ‘pragmatisch’, gericht op het aanpakken van de risico’s van door modellen gegenereerde schade, zoals ongekwalificeerd advies en PII-lekken, door genuanceerde veiligheidsrichtlijnen toe te passen.

De moderatie-API pakt problemen met vooringenomenheid en aanpassingsbehoeften aan

AI-gestuurde contentmoderatiesystemen bieden potentieel voor efficiënt, schaalbaar contentbeheer, maar ze zijn niet zonder beperkingen. Soortgelijke AI-systemen hebben historisch gezien te kampen gehad met vooroordelen, vooral bij het detecteren van taalstijlen die verband houden met bepaalde demografische categorieën. Uit onderzoek blijkt bijvoorbeeld dat taalmodellen zinnen in het Afrikaans-Amerikaans Vernaculair Engels (AAVE) vaak als onevenredig giftig bestempelen, en berichten waarin handicaps worden besproken ten onrechte als overdreven negatief bestempelen.

Generatieve AI versus voorspellende AI: Volledige vergelijking

Mistral erkent de uitdagingen van het creëren van een onbevooroordeelde moderatietool en stelt dat hun moderatiemodel weliswaar zeer nauwkeurig is, maar nog steeds in ontwikkeling is. Het bedrijf moet de prestaties van zijn API nog vergelijken met gevestigde tools zoals Jigsaw’s Perspective API of OpenAI’s moderatie-API. Mistral streeft ernaar zijn tool te verfijnen door voortdurende samenwerking met klanten en de onderzoeksgemeenschap, door te zeggen: “We werken samen met onze klanten om schaalbare, lichtgewicht en aanpasbare moderatietools te bouwen en te delen.”

Batch API verlaagt verwerkingskosten met 25%

Mistral introduceerde ook een batch-API die is ontworpen voor de afhandeling van grote verzoeken. Door deze verzoeken asynchroon te verwerken, beweert Mistral dat de batch-API de verwerkingskosten met 25% kan verlagen. Deze nieuwe functie sluit aan bij vergelijkbare batchverwerkingsopties die worden aangeboden door andere technologiebedrijven zoals Anthropic, OpenAI en Google, die tot doel hebben de efficiëntie te verbeteren voor klanten die aanzienlijke gegevensstromen beheren.

De contentmoderatie-API van Mistral is bedoeld om aanpasbaar te zijn in een reeks gebruiksscenario’s en talen. Het model is getraind om tekst in meerdere talen te verwerken, waaronder Arabisch, Chinees, Italiaans, Japans, Koreaans, Portugees, Russisch en Spaans. Deze meertalige mogelijkheid zorgt ervoor dat het model ongewenste inhoud in verschillende regio’s en taalcontexten kan aanpakken. De tool van Mistral biedt twee eindpunten die zijn afgestemd op onbewerkte tekst of conversatiecontexten, en voorzien in uiteenlopende gebruikersbehoeften. Het bedrijf biedt gedetailleerde technische documentatie en benchmarks waarmee gebruikers de prestaties van het model kunnen meten.

Terwijl Mistral zijn tool blijft verfijnen, biedt de API een uniek aanpassingsniveau, waardoor gebruikers parameters kunnen aanpassen op basis van specifieke veiligheidsnormen voor inhoud.

Uitgelichte afbeeldingscredits: Mistral