Volgens een BBC Volgens het rapport kreeg het onlangs uitgebrachte AI-platform van Apple, Apple Intelligence, te maken met terugslag nadat het ten onrechte de dood van Luigi Mangione, een verdachte van moord, had aangekondigd. De melding, die vorige week via de iPhone werd verzonden, vatte een BBC onjuist rapporteren, wat leidt tot kritiek van zowel gebruikers als mediaorganisaties. Dit incident roept belangrijke vragen op over de betrouwbaarheid en nauwkeurigheid van door AI gegenereerde informatie.

De AI-tool van Apple geeft een onjuiste melding van de dood van de verdachte

Apple heeft Apple Intelligence geïntegreerd in zijn besturingssystemen, waaronder iOS 18 en macOS Sequoia. Onder de functies biedt het platform generatieve AI-tools die zijn ontworpen voor schrijven en het maken van afbeeldingen. Bovendien biedt het een functie om meldingen te categoriseren en samen te vatten, gericht op het verminderen van afleiding van de gebruiker gedurende de dag. De recente valse meldingen benadrukken echter mogelijke onnauwkeurigheden en tekortkomingen van deze nieuwe functie, waardoor gebruikers verbijsterd en bezorgd zijn over de integriteit van de informatie die wordt gedeeld.

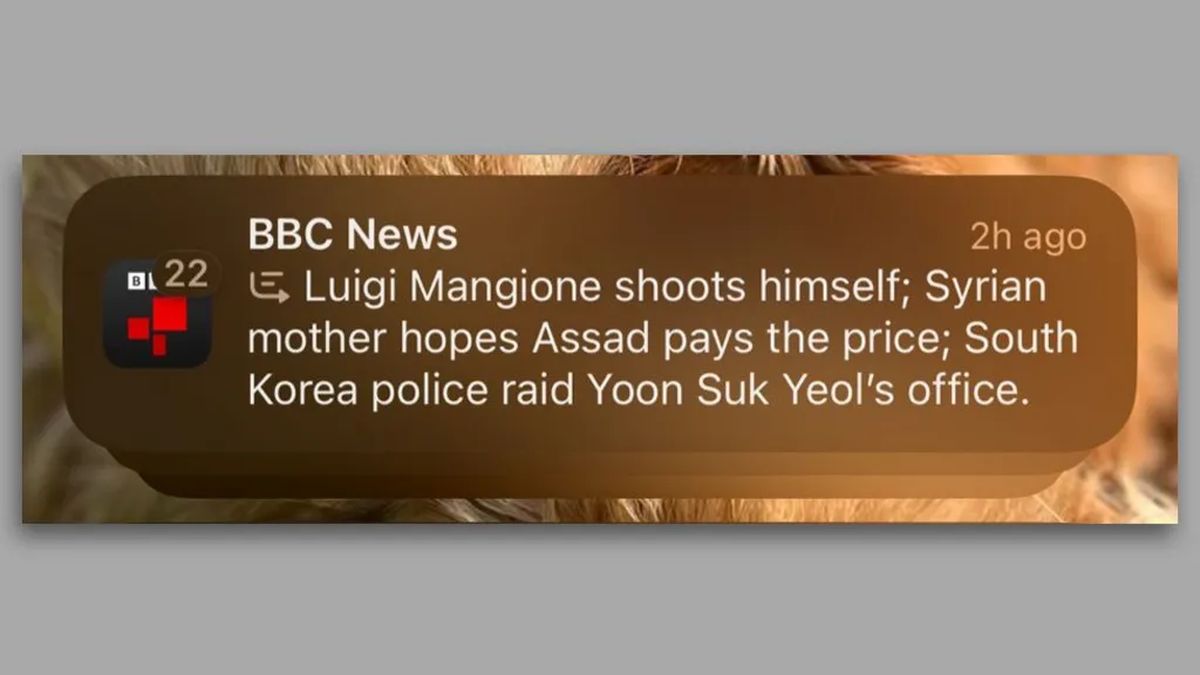

In een melding gedateerd 13 december 2024 ontvingen iPhone-gebruikers een bericht waarin stond: “Luigi Mangione schiet zichzelf neer”, naast twee andere samenvattingen van het laatste nieuws. Deze foutieve melding trok snel de aandacht, vooral omdat er een cruciaal detail in stond met betrekking tot Mangione, die ervan wordt beschuldigd de voormalige CEO van UnitedHealthcare, Brian Thompson, op 4 december te hebben vermoord. BBCdat geen informatie had gepubliceerd over Mangione die zichzelf zou hebben neergeschoten, diende een klacht in bij Apple. Het netwerk heeft Apple sindsdien opgeroepen zijn generatieve AI-tool te heroverwegen.

Het onderliggende probleem lijkt voort te komen uit de taalmodellen (LLM’s) die door Apple Intelligence worden gebruikt. Volgens De straatKomninos Chatzipapas, directeur bij Orion AI Solutions, “LLM’s zoals GPT-4o… hebben niet echt enig inherent begrip van wat waar is en wat niet.” Deze modellen voorspellen op statistische wijze de volgende woorden op basis van enorme datasets, maar deze methode kan resulteren in betrouwbaar klinkende inhoud die feiten verkeerd voorstelt. In dit geval speculeerde Chatzipapas dat Apple misschien onbedoeld zijn samenvattingsmodel had getraind met vergelijkbare voorbeelden waarbij individuen zichzelf neerschoten, wat de misleidende kop opleverde.

De implicaties van dit incident reiken verder dan de interne praktijken van Apple. Reporters Without Borders heeft er bij het bedrijf op aangedrongen de samenvattingsfunctie te verwijderen, waarbij de nadruk wordt gelegd op de ernst van het verspreiden van onnauwkeurige informatie via gerenommeerde mediakanalen. Vincent Berthier van Verslaggevers Zonder Grenzen gearticuleerd zorgen over door AI gegenereerde desinformatie die de geloofwaardigheid van nieuwsbronnen schaadt. Hij verklaarde: “AI’s zijn waarschijnlijkheidsmachines, en feiten kunnen niet worden bepaald door een worp met de dobbelstenen.” Dit versterkt het argument dat AI-modellen momenteel niet de volwassenheid hebben die nodig is om betrouwbare nieuwsverspreiding te garanderen.

Laat AI niet profiteren van de pijn en het verdriet van gezinnen

Dit incident staat niet op zichzelf. Sinds de lancering van Apple Intelligence in de VS in juni hebben gebruikers nog meer onnauwkeurigheden gemeld, waaronder een melding waarin ten onrechte werd vermeld dat de Israëlische premier Benjamin Netanyahu was gearresteerd. Hoewel het Internationale Strafhof een arrestatiebevel tegen Netanyahu uitvaardigde, liet de kennisgeving de cruciale context achterwege en werd alleen de zinsnede “Netanyahu gearresteerd” weergegeven.

De controverse rond Apple Intelligence brengt uitdagingen aan het licht die verband houden met de autonomie van nieuwsuitgevers in het tijdperk van AI. Terwijl sommige mediaorganisaties actief gebruik maken van AI-tools voor schrijven en rapporteren, ontvangen gebruikers van de functie van Apple samenvattingen die de feiten mogelijk verkeerd weergeven, terwijl ze allemaal onder de naam van de uitgever verschijnen. Dit principe zou bredere implicaties kunnen hebben voor de manier waarop informatie wordt gerapporteerd en waargenomen in het digitale tijdperk.

Apple heeft nog niet gereageerd op vragen over het beoordelingsproces of op eventuele stappen die het bedrijf in verband hiermee wil ondernemen BBC’s zorgen. Het huidige landschap van AI-technologie, dat aanzienlijk is gevormd door de introductie van platforms als ChatGPT, heeft snelle innovatie gestimuleerd, maar creëert ook een vruchtbare bodem voor onnauwkeurigheden die het publiek kunnen misleiden. Naarmate het onderzoek naar door AI gegenereerde inhoud en de implicaties daarvan voortduurt, wordt het belang van het garanderen van betrouwbaarheid en nauwkeurigheid steeds belangrijker.

Uitgelichte afbeeldingscredits: Maxim Hopman/Unsplash